Vor einigen Wochen hatte ich mich hier in einem Blog-Rant darüber beklagt, wie fahrlässig heutzutage in der Markt- und Meinungsforschung oft mit den Attributen “repräsentativ” und “signifikant” umgesprungen wird. Ein aktuelles und in vielerlei Hinsicht typisches Beispiel hierfür (sowie auch für den Trend zu selbstselektiven Online-Stichproben), ist mir dieser Tage bei der Suche nach Umfragebeispielen für meine Statistik-Vorlesung in die Hände gefallen.

Unter der “Clickbait”-Überschrift “Troops prefer Trump to Clinton by a huge margin” wird in der “Military Times” (Sightline Media Group) in epischer Breite eine Umfrage ausgewertet, die vermeintlich belegt, dass die US-Militärangehörigen bei der im November anstehenden Präsidentschaftswahl überwiegend für Donald Trump stimmen werden. Erst ganz am Ende des Artikels – in dem natürlich durchgängig mit Prozentangaben gearbeitet wird, um keine absoluten Werte nennen zu müssen – folgen einige kurze Erklärungen zur Methodik der Erhebung. Unter anderem heisst es hier:

“More than 59,000 subscribers received e-mail invitations to participate. In total, 951 respondents completed the survey.”

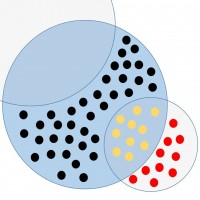

Mit anderen Worten: Von mehr als 59.000 angeschriebenen Abonnenten haben sich lediglich 951 beteiligt. Als Vollerhebung ist die Untersuchung damit auf ganzer Linie gescheitert, als Stichprobe taugt sie allerdings ebenfalls nicht, da die Probandinnen und Probanden sich selbst auswählen konnten – und eher nicht davon auszugehen ist, dass sich die Motivation zur Teilnahme als Merkmal zufällig in der Gruppe aller angesprochenen Abonnenten verteilt. Dies ganz davon abgesehen, dass man selbst bei einer erfolgreichen Vollerhebung oder Stichprobe hätte hinterfragen müssen, inwiefern die Gruppe der E-Mail-Abonnenten der “Military Times” überhaupt stellvertretend für die Gesamtheit der US-Militärangehörigen steht. Trotz dieser Schwächen werden die Daten aber nicht nur breit ausgewertet, es wird auch noch eine – zumindest partielle – Repräsentativität unterstellt:

“The sample is not a perfect representation of the military as a whole; it over-represents officers and noncommissioned officers, and under-represents junior enlisted personnel. However, it is representative of the more senior and career-oriented members of the force who run the military’s day-to-day operations and carry out its policies.”

Angesichts der selbstselektiven Teilnehmerauswahl sowie der niederschmetternden Teilnahmequote ist es in der Tat mehr als nur fahrlässig, anzunehmen, dass einzelne Gruppen, die in der gescheiterten Erhebung – möglicherweise rein zufällig – stärker als andere Gruppen vertreten sind, repräsentativ durch diese abgebildet werden. Trotzdem wurde der Artikel auf Facebook zum Zeitpunkt dieses Artikels bereits über 42.000 Mal (!) geteilt – und das innerhalb von nur drei Tagen. Ein gutes Beispiel dafür, wie handwerklich wirklich schlecht gemachte Statistiken sich munter weiterverbreiten können – wenn man deren “Ergebnisse” nur im Brustton der Überzeugung verkauft…

Kommentare (8)