»Was ist der Mensch?« Klassischerweise fällt die Beantwortung dieser Frage ja in den Zuständigkeitsbereich der Philosophie. Doch immer häufiger kommen Antworten auf diese anthropologische Kernfrage auch von anderen wissenschaftlichen Disziplinen. Etwa von der Hirnforschung, wenn sie uns mitteilt, daß der ‘freie Wille’ doch nur eine Illusion sei. Und natürlich hat auch die Biologie hier etwas zu sagen.

Wissenschaft ist eine Kerze in einer dunklen von Dämonen beherrschten Welt.

Wenn man Pech hat, bekommt man freilich die PR-Parolen von Gentechnik-Pionier Craig Venter zu hören, der nach der Entschlüsselung (und Enträtselung) des Genoms nun die Synthetisierung des Lebens propagiert. Wenn man Glück hat, dann stammen die Antworten, die die Lebenswissenschaften auf diese allerersten Fragen des Menschen gibt, von Gottfried Schatz. Für den besteht das Erfolgsgeheimnis des Lebens nämlich just in dessen Rätselhaftigkeit, die sich konsequent jeder Kontrolle entziehe. Und so steht für den Biochemiker Schatz fest, daß wir “nicht Sklaven unserer Gene sind”.

Es war also zweifellos ein glücklicher Zufall, daß im Mittelpunkt des “Life Science Dialogue” der vergangene Woche Anfang Juni in Heidelberg stattfand, der Vortrag von Prof. Dr. Gottfried Schatz stand. Und der outete sich gleich zu Beginn seiner Ausführungen als Fan von Carl Sagan, dessen Credo er ausdrücklich zustimme: “Wissenschaft ist eine Kerze in einer dunklen von Dämonen beherrschten Welt.”

»Wir sind nicht gesund, sondern nur noch nicht gut genug getestet.«

In seiner kurzen Einführung hatte Dr. Stephan Sigrist von W.I.R.E. kurz die Ausgangslage skizziert. Die Medizin agiere – so Sigrist sinngemäß – zunehmend in einem Spannungsverhältnis: einerseits habe der medizinische Fortschritt und Wissenszuwachs dazu geführt, daß wir Diagnosen immer früher und präziser stellen können. Andererseits hätten sich viele der allzu optimistischen Hoffnungen auf eine gentechnologisch induzierte Revolution in der Medizin doch (noch?) nicht erfüllt und gleichzeitig steige der Kostendruck auf das Gesundheitssystem (was sich schlicht in dem Umstand niederschlägt, daß nicht alles, was möglich ist, auch bezahlbar ist.).

»Sind wir nur biochemische Maschinen, die von Genen gesteuert werden?«

Doch zurück zum Vortrag von Gottfried Schatz. Für den deutsch-schweizerischen Biochemiker, der als Mitentdecker der mitochondrialen DNA gilt und auf eine mehr als vierzigjährige Karriere in der Spitzenforschung zurückblickt, steht unbestritten fest: “Die Biologie ist die Wissenschaft von uns selbst.”

Ausgangspunkt seiner Überlegungen war folgende Frage: “Sind wir nur biochemische Maschinen, die von Genen gesteuert werden?” Stellte man Craig Venter diese Frage, so lautete seine Antwort vermutlich klar und eindeutig: Ja. Doch für Schatz ist die Sache so einfach nicht. Seine Gründe legte er in einer dreistufigen Argumentationskette dar.

Epigenetik, oder: Wie gelebtes Leben das Genom prägt

Epigenetik, oder: Wie gelebtes Leben das Genom prägt

Die Vorstellung, wir seien nur die besagten Maschinen, die von einer fix vorgegebenen Software (unserer DNA) gesteuert würden, ist in den Augen von Gottfried Schatz naiv. Und überhaupt widerspräche sie vielen Vorgängen in der Natur. Denn wieso, so fragte Schatz, werden denn eineiige Zwillinge im Lauf der Zeit immer verschiedener? Eigentlich wäre doch zu erwarten, daß bei identischem Genom tatsächlich das gleiche (biologisch-physiologische) Programm abliefe, oder?

Daß dem nicht so ist, liegt – wie Schatz eindrucksvoll illustrierte – am Epigenom. Während die DNA der bloße Text ist, unser grundlegender Bauplan des Lebens, so sorgt das Epigenom dafür, welche Passagen der DNA tatsächlich abgelesen werden und somit relevant sind oder werden. Wie die epigenetische Forschung der letzten Jahre zeigen konnte, gibt es eben raffinierte Mechanismen, die kontrollieren, wie die DNA genutzt wird, welche Proteine produziert werden oder eben nicht. Und die Epigenetik ist – wie immer mehr interessante Studien belegen – durch die Umwelt (was nichts anderes heißt: unser Leben bzw. unseren Lebenswandel) beeinflußbar.

Unsere Ernährungsgewohnheiten, Stress, Sport, unsere Leidenschaften und Ängste und all das, was uns je individuell widerfährt und worauf wir (zumindest teilweise) Einfluß haben, wirkt sich eben auf die epigenetischen Mechanismen aus. Die Auswirkungen vollziehen sich dann zum Beispiel über die Histonmodifikation (die den Ableseprozeß für bestimmte Proteine aktivieren oder unterbinden kann), die RNA-Interferenz (die im letzten Moment dazwischenfunkt, bevor die Proteinsynthese stattfindet) oder die sog. Methylierung. Dabei wird eine Methyl(CH3)-Gruppe an bestimmten Stellen der DNA plaziert und somit wird verhindert, daß der zugehörige Text abgelesen wird.

Schatz erläuterte den Mechanismus der Methylierung und illustrierte, daß diese Markierungen in unserer DNA eben durch gesunde Ernährung positive, durch zuviel Stress oder zu wenig Bewegung negative Effekte haben können. Und – hier wird es besonders spannend – die Methylgruppen werden teilweise auch vererbt. Es ist über diese epigenetische Schnittstelle also sogar möglich, so etwas wie intergenerationelles Lernen zu ermöglichen. Bestimmte Informationen, welche Gene wichtig sind (und abgelesen werden) und welche irrelevant sind, können also vererbt werden. Und darauf haben wir (in gewissem Umfang) auch Einfluß.

Der (göttliche) Zufall

Wir selbst sind also – das war der erste Argumentationsschritt von Gottfried Schatz – durchaus in der Lage, bestimmte ‘epigenetische Schalter’ zu kontrollieren, die sich auf unsere Gesundheit (und sogar diejenige unserer Kinder) auswirken. Mit dem Gegenteil von Kontrolle, nämlich mit dem (vieleicht ja göttlichen?) Zufall hatte das zweite Argument zu tun. “Im Leben einer Zelle gibt es Zufallsprozesse, die irreversibel sind”, so erläuterte Schatz.

»Im Leben einer Zelle gibt es Zufallsprozesse, die irreversibel sind.«

Die Natur kann aus einem Genom ganz verschiedene lebensfähige Organismen schaffen. Eine – wenigstens für die Ohren eines biochemischen Laien – bemerkenswerte Aussage. Für Schatz freilich nur ein weiteres Indiz für die ganz fabelhaft organisierte Natur. Denn diese Variationsmöglichkeiten (die eben auch den Zufall nutzen) seien die wahre Stärke der Evolution.

Gottfried Schatz ist – das als kleine Zwischenbemerkung – einer derjenigen Wissenschaftler, die so wunderbar eindrücklich und mitreißend über die Welt der Forschung erzählen, daß man sich wünscht, daß der Vortrag nicht 90 Minuten, sondern mindestens doppelt so lange dauern möge. Denn Schatz (seine Emeritierung liegt schon einige Zeit zurück und doch sprüht er nur so vor Begeisterung, wenn er über die Wissenschaft spricht) liefert gleich dutzendfach bemerkens- und bedenkenswerte Statements ab. “Unser Dasein ist nichts anderes als gigantisch verstärktes molekulares Rauschen!” – so machte er beispielsweise an dieser Stelle deutlich.

Sieg der Komplexität

Der dritte Punkt in seiner Argumentationskette kreiste um das Stichwort ‘Komplexität’. Wie bereits oben angedeutet, so ist für Schatz die Vorstellung ziemlich abwegig, wir seien streng determinierte Apparate, deren Leben und Verhalten direkt durch unsere Gene (fremd-)gesteuert werde. Für ihn steht vielmehr fest: “Unser Genom ist genauso groß, wie rätselhaft.”

Die Vorstellung, wir seien biochemische Maschinen, determinierte Apparate, die durch die zentrale Software ‘DNA’ gesteuert werden, ist abwegig.

Und zwei menschliche Genome unterscheiden sich gerade einmal um 0,5% voneinander und dennoch gibt es eine so enorme Variationsbreite an menschlichem Leben – Schatz, so führte er aus, genügt im Grunde schon diese Erkenntnis, die uns vom vermeintlichen Joch der Versklavung durch unser Genom befreie.

Für Schatz – das war so etwas wie der Dreh- und Angelpunkt seiner Ausführungen – steht fest: das höchste Ziel der Natur ist es, Vielfalt zu schaffen. Und das versucht sie mit allen Tricks, allen ihr zur Verfügung stehenden Mitteln. Insofern hieße es die Natur zu unterschätzen, wenn man glaubte, in der DNA liege das Programm vor, das (ohne das weitere Faktoren mit ins Spiel gebracht würden) allem Leben seine konkrete Form diktieren würde. Es ist eher das freie Spiel, die lange Leine an der die DNA agiert. Umwelteinflüsse (und unser eigenes Verhalten) sind eine Einflußvariable, wie uns die Epigenetik zeigt. Zufälle und Komplexität tun ihr weiteres.

Das Konzert des Lebens

Das Konzert des Lebens

Am Ende erläuterte Schatz sein Verständnis in folgendem Bild: jede befruchtete Eizelle ist wie ein Orchester, das auf seinen Einsatz wartet. Doch was wir hören, das hängt von vielen weiteren Faktoren ab. Vom Takt des Dirigenten, der Virtuosität und der Tagesform der einzelnen Musiker, der Qualität der Instrumente, der Akustik des Konzertsaals etc.

Ein schönes Bild. Und ein schöner Vortrag. So lebendig kann man über Wissenschaft sprechen.

Daß die anschließende Diskussion (die länger als 1 1/2h dauerte) lebhaft und anregend war, daß von den Teilnehmern am “Life Science Dialogue” weitere interessante Perspektiven eingebracht wurden, war dann eher kein Zufall, sondern das folgerichtige Produkt spannender Wissenschaft.

—

Anmerkung: Der “Life Science Dialogue” wird von der Dr. Rainer Wild-Stiftung organisiert und durchgeführt. Weitere Infos zur Veranstaltungsreihe waren bereits in diesem Text bei ScienceBlogs zu lesen.

—

Lektüre-Tipps (Link öffnet Amazon-Website):

* Das Posting war an dieser Stelle bereits im Juni für kurze Zeit lesbar, dann aber durch einen Systemfehler wieder offline gegangen.

]]>

Das war’s. Fast 3.000 Tweets, mehr als 1.500 Artikel und Postings, hunderte Topthemen und dutzende SciencePicture habe ich in den letzten Jahren hier für ScienceBlogs geschrieben und erstellt. Dieses kleine Posting ist nun mein persönlicher Abschiedsgruß. Mit ScienceBlogs geht es selbstverständlich weiter. Mit neuen, aber doch wohlbekannten Personen hinter den Kulissen.

Das war’s. Fast 3.000 Tweets, mehr als 1.500 Artikel und Postings, hunderte Topthemen und dutzende SciencePicture habe ich in den letzten Jahren hier für ScienceBlogs geschrieben und erstellt. Dieses kleine Posting ist nun mein persönlicher Abschiedsgruß. Mit ScienceBlogs geht es selbstverständlich weiter. Mit neuen, aber doch wohlbekannten Personen hinter den Kulissen.

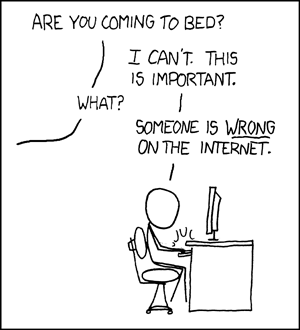

Und spätabends gab es nicht selten Diskussionen mit meiner Freundin, die manchmal dann doch genervt war, wenn ich auch um 23.00Uhr oder später (gerne auch bis 01.00 oder 02.00Uhr in der Nacht) noch Kommentare beantworten oder eben unbedingt noch ein Topthema für den nächsten Morgen schreiben wollte. Das war in den letzten Jahren mein Leben. Und das war wirklich ausgesprochen klasse.

Und spätabends gab es nicht selten Diskussionen mit meiner Freundin, die manchmal dann doch genervt war, wenn ich auch um 23.00Uhr oder später (gerne auch bis 01.00 oder 02.00Uhr in der Nacht) noch Kommentare beantworten oder eben unbedingt noch ein Topthema für den nächsten Morgen schreiben wollte. Das war in den letzten Jahren mein Leben. Und das war wirklich ausgesprochen klasse.

Aber vermutlich wäre es auch vermessen, wenn man von einer solchen Veranstaltung an zwei verregneten Tagen im September die Lösung für die Energiefragen der Zukunft erwarten würde. Darüber zerbrechen sich schließlich Heerscharen von Experten seit Jahren die Köpfe. Aber kreative Ideen gab es eben schon. Und die Möglichkeit zu Beteiligung. Und das ist doch schon was.

Aber vermutlich wäre es auch vermessen, wenn man von einer solchen Veranstaltung an zwei verregneten Tagen im September die Lösung für die Energiefragen der Zukunft erwarten würde. Darüber zerbrechen sich schließlich Heerscharen von Experten seit Jahren die Köpfe. Aber kreative Ideen gab es eben schon. Und die Möglichkeit zu Beteiligung. Und das ist doch schon was.

Eigentlich ist das ja eine Schnapsidee: 200 Personen sollen an 21 Tischen an 2 Tagen über 1 Thema diskutieren, streiten und sich letztlich doch auch wieder auf gemeinsame Positionen einigen. Und dennoch hat sich die Bürgerkonferenz zum Thema “Energienutzung der Zukunft” genau das zum Ziel gesetzt. Es ist ein Experiment. In mehrfacher Hinsicht. Einige Beobachtungen am Ende des ersten Tages…

Eigentlich ist das ja eine Schnapsidee: 200 Personen sollen an 21 Tischen an 2 Tagen über 1 Thema diskutieren, streiten und sich letztlich doch auch wieder auf gemeinsame Positionen einigen. Und dennoch hat sich die Bürgerkonferenz zum Thema “Energienutzung der Zukunft” genau das zum Ziel gesetzt. Es ist ein Experiment. In mehrfacher Hinsicht. Einige Beobachtungen am Ende des ersten Tages…

Epigenetik, oder: Wie gelebtes Leben das Genom prägt

Epigenetik, oder: Wie gelebtes Leben das Genom prägt Das Konzert des Lebens

Das Konzert des Lebens

Mitte des 19. Jahrhunderts wurde die winzige Reblaus (Daktulosphaira vitifoliae FITCH) aus Nord-Amerika nach Europa eingeschleppt. Innerhalb der folgenden Jahre zerstörte die Zwerglaus große Weinflächen und verursachte einen immensen ökonomischen Schaden. Dieser entstand durch die unterirdische Saugtätigkeit der Reblaus an den Wurzeln. Bei dieser entsteht eine Galle, die in der Wissenschaft je nach Alter und Größe als Nodosität oder Tuberosität bezeichnet wird und im letzteren Fall eine Eintrittspforte für weitere im Boden lebende Krankheitserreger darstellen kann.

Mitte des 19. Jahrhunderts wurde die winzige Reblaus (Daktulosphaira vitifoliae FITCH) aus Nord-Amerika nach Europa eingeschleppt. Innerhalb der folgenden Jahre zerstörte die Zwerglaus große Weinflächen und verursachte einen immensen ökonomischen Schaden. Dieser entstand durch die unterirdische Saugtätigkeit der Reblaus an den Wurzeln. Bei dieser entsteht eine Galle, die in der Wissenschaft je nach Alter und Größe als Nodosität oder Tuberosität bezeichnet wird und im letzteren Fall eine Eintrittspforte für weitere im Boden lebende Krankheitserreger darstellen kann.

Physiker sind ganz verrückt nach leckeren Honig-broten und Chemiker hangeln sich wie Tarzan durch den Dschungel. Das sind zwei der Erkenntnisse, die das österreichische Famelab-Finale 2010 bereithielt. Aber natürlich lernte das Publikum im Festsaal des Technischen Museums in Wien noch viel mehr: daß man mit einer Wasserflasche, einem Streichholz und geeigneten Druckbedingungen auf der Bühne Wolken erzeugen kann zum Beispiel. Und natürlich konnte man lernen, daß Wissenschaft nicht langweilig ist, sondern sehr kreativ und humorvoll vermittelt werden kann.

Physiker sind ganz verrückt nach leckeren Honig-broten und Chemiker hangeln sich wie Tarzan durch den Dschungel. Das sind zwei der Erkenntnisse, die das österreichische Famelab-Finale 2010 bereithielt. Aber natürlich lernte das Publikum im Festsaal des Technischen Museums in Wien noch viel mehr: daß man mit einer Wasserflasche, einem Streichholz und geeigneten Druckbedingungen auf der Bühne Wolken erzeugen kann zum Beispiel. Und natürlich konnte man lernen, daß Wissenschaft nicht langweilig ist, sondern sehr kreativ und humorvoll vermittelt werden kann.

Die Jury-Silbermedaille ging nach Innsbruck. Philip Handle (rechts) überzeugte wie schon

Die Jury-Silbermedaille ging nach Innsbruck. Philip Handle (rechts) überzeugte wie schon

Und daß eben bspw. die kulturellen und sozialen Faktoren bei der Implementation von Technik in Drittwelt-Ländern entscheidend sind. Das klingt jetzt in diesen zwei Sätzen vermutlich etwas verschwurbelt, in seinen beiden Kurzvorträgen illustrierte Andreas Aschaber diesen Zusammenhang allerdings sehr anschaulich am konkreten Beispiel des Einsatzes von Biogas in Burkina Faso. Denn hier gilt es natürlich sowohl die traditonellen Ess- und Zubereitungsgewohnheiten genauso zu berücksichtigen, wie der Stammesälteste und seine Position mit einzubeziehen ist. Die Präsentationen von Andreas (der zu diesem Thema Feldforschung betreibt und promoviert) kamen jedenfalls sehr gut an – und doch reichte es letztlich nicht bis ins Finale.

Und daß eben bspw. die kulturellen und sozialen Faktoren bei der Implementation von Technik in Drittwelt-Ländern entscheidend sind. Das klingt jetzt in diesen zwei Sätzen vermutlich etwas verschwurbelt, in seinen beiden Kurzvorträgen illustrierte Andreas Aschaber diesen Zusammenhang allerdings sehr anschaulich am konkreten Beispiel des Einsatzes von Biogas in Burkina Faso. Denn hier gilt es natürlich sowohl die traditonellen Ess- und Zubereitungsgewohnheiten genauso zu berücksichtigen, wie der Stammesälteste und seine Position mit einzubeziehen ist. Die Präsentationen von Andreas (der zu diesem Thema Feldforschung betreibt und promoviert) kamen jedenfalls sehr gut an – und doch reichte es letztlich nicht bis ins Finale.  Omega-3-Fettsäuren sind populärer denn je. In den letzten Jahren werden immer mehr Lebensmittel mit Omega-3-Fettsäuren aufgepeppt. Sie sollen nicht nur das Risiko von Herzinfarkten und Schlaganfällen senken, sondern auch noch ganz generell vor Krebs schützen, gegen Depressionen sowieso und vor dem kognitiven Abbau im Alter bewahren. Eine aktuelle Studie sorgt hier etwas für Ernüchterung: die Gedächtnisleistung von Senioren kann die Einnahme von Omega-3-Fettsäuren nicht verbessern.

Omega-3-Fettsäuren sind populärer denn je. In den letzten Jahren werden immer mehr Lebensmittel mit Omega-3-Fettsäuren aufgepeppt. Sie sollen nicht nur das Risiko von Herzinfarkten und Schlaganfällen senken, sondern auch noch ganz generell vor Krebs schützen, gegen Depressionen sowieso und vor dem kognitiven Abbau im Alter bewahren. Eine aktuelle Studie sorgt hier etwas für Ernüchterung: die Gedächtnisleistung von Senioren kann die Einnahme von Omega-3-Fettsäuren nicht verbessern.

Wie arbeitet unser Gehirn? Wie funktioniert Wahrnehmung? Welche Faktoren prägen unser Gedächtnis? – Es gibt so unendlich viele spannende Fragen an die Hirnforschung. Doch deren Antworten sind bislang kaum zufriedenstellend. Zwar findet man in den einschlägigen neurowissenschaftlichen Journals fast im Wochentakt interessante Veröffentlichungen, aber das sind dann allenfalls winzig kleine Mosaiksteinchen, die sich vielleicht irgendwann in ein großes Bild einfügen lassen, das uns dann verstehen hilft, wie unser Gehirn tatsächlich “tickt”. Aber bis dahin ist es noch weit.

Wie arbeitet unser Gehirn? Wie funktioniert Wahrnehmung? Welche Faktoren prägen unser Gedächtnis? – Es gibt so unendlich viele spannende Fragen an die Hirnforschung. Doch deren Antworten sind bislang kaum zufriedenstellend. Zwar findet man in den einschlägigen neurowissenschaftlichen Journals fast im Wochentakt interessante Veröffentlichungen, aber das sind dann allenfalls winzig kleine Mosaiksteinchen, die sich vielleicht irgendwann in ein großes Bild einfügen lassen, das uns dann verstehen hilft, wie unser Gehirn tatsächlich “tickt”. Aber bis dahin ist es noch weit.

Es sieht aus wie ein schlanker, eleganter Mix aus Twitter, Friendfeed, Blogkommentaren und Buzz. Und es ist – so jedenfalls die Idee – zugeschnitten auf die Bedürfnisse von Wissenschaftlern, die sich zu aktuellen wissenschaftlichen Themen miteinander austauschen. ScienceFeed heißt diese neue Plattform, die seit wenigen Stunden online ist und tatsächlich mehr Raum bietet für das, was Forscher alltäglich beschäftigt.

Es sieht aus wie ein schlanker, eleganter Mix aus Twitter, Friendfeed, Blogkommentaren und Buzz. Und es ist – so jedenfalls die Idee – zugeschnitten auf die Bedürfnisse von Wissenschaftlern, die sich zu aktuellen wissenschaftlichen Themen miteinander austauschen. ScienceFeed heißt diese neue Plattform, die seit wenigen Stunden online ist und tatsächlich mehr Raum bietet für das, was Forscher alltäglich beschäftigt.

Es klingt unglaublich und für viele junge Eltern wie ein schlechter Witz: in Deutschland sind derzeit insgesamt sieben Impfstoffe gegen Kinderkrankheiten nicht oder nur schwer lieferbar, darunter der Sechsfach-Impfstoff für Säuglinge “Infanrix hexa” von GlaxoSmithKline. Die Impfstoffhersteller haben offenbar seit letztem Herbst fast ihre gesamten Produktionskapazitäten für die Herstellung des Schweinegrippe-Impfstoffs reserviert. Wie man dabei vergessen konnte, daß andere Impfstoffe weiterhin nachgefragt werden und lieferbar sein müssen, ist rätselhaft.

Es klingt unglaublich und für viele junge Eltern wie ein schlechter Witz: in Deutschland sind derzeit insgesamt sieben Impfstoffe gegen Kinderkrankheiten nicht oder nur schwer lieferbar, darunter der Sechsfach-Impfstoff für Säuglinge “Infanrix hexa” von GlaxoSmithKline. Die Impfstoffhersteller haben offenbar seit letztem Herbst fast ihre gesamten Produktionskapazitäten für die Herstellung des Schweinegrippe-Impfstoffs reserviert. Wie man dabei vergessen konnte, daß andere Impfstoffe weiterhin nachgefragt werden und lieferbar sein müssen, ist rätselhaft.

“Die Großhirnrinde ist eine Verstehensmaschine”, erklärt Tobias Hürter, als er aktuelle Studien von Neurowissenschaftlern vorstellt. In seinem Vortrag beschäftigt er sich mit der Frage, unter welchen Bedingungen wir uns an unsere Träume erinnern und was bei sogenannten Klarträumen passiert.

“Die Großhirnrinde ist eine Verstehensmaschine”, erklärt Tobias Hürter, als er aktuelle Studien von Neurowissenschaftlern vorstellt. In seinem Vortrag beschäftigt er sich mit der Frage, unter welchen Bedingungen wir uns an unsere Träume erinnern und was bei sogenannten Klarträumen passiert.

Genauso lohnend wie eben ein Besuch bei der Nerd Nite. Denn bei welch anderer Gelegenheit bekommt man so sympathisch und kompetent die Gedankenwelt und Arbeiten eines Nicolaus von Kues vorgeführt? Marco Böhlandt, promovierter Wissenschaftshistoriker und ausgewiesener Fachmann, sprach über “Wege ins Unendliche – Das Problem der Kreisquadratur bei Nicolaus Cusanus (1401-1464)”. Hört sich vielleicht trocken an, war es aber keineswegs. Denn Böhlandt erfreute nicht nur mit einen wunderbar nerdigen Erscheinungsbild, sondern skizzierte auch für Nichtmathematiker verständlich, womit sich Cusanus beschäftigte: damit daß eine Gerade und eine Kreistangente eben (fast) in eins fallen, wenn der Kreisdurchmesser ins Unendliche wächst.

Genauso lohnend wie eben ein Besuch bei der Nerd Nite. Denn bei welch anderer Gelegenheit bekommt man so sympathisch und kompetent die Gedankenwelt und Arbeiten eines Nicolaus von Kues vorgeführt? Marco Böhlandt, promovierter Wissenschaftshistoriker und ausgewiesener Fachmann, sprach über “Wege ins Unendliche – Das Problem der Kreisquadratur bei Nicolaus Cusanus (1401-1464)”. Hört sich vielleicht trocken an, war es aber keineswegs. Denn Böhlandt erfreute nicht nur mit einen wunderbar nerdigen Erscheinungsbild, sondern skizzierte auch für Nichtmathematiker verständlich, womit sich Cusanus beschäftigte: damit daß eine Gerade und eine Kreistangente eben (fast) in eins fallen, wenn der Kreisdurchmesser ins Unendliche wächst.  Diese Grundkonstellation ist der Ausgangspunkt für Frank Schirrmacher, der in seinem Buch “

Diese Grundkonstellation ist der Ausgangspunkt für Frank Schirrmacher, der in seinem Buch “

Ginkgo-Präparate sind ein Klassiker der Naturheilkunde. Bereits seit den 60er Jahren sorgen Extrakte aus den Blättern und Samen des Ginkgobaums für fette Umsätze. Für ein besseres Gedächtnis sollen die Präparate sorgen, die Konzentrationsfähigkeit erhöhen und allgemein der Demenz vorbeugen. Doch eine neue Studie zeigt: gegen den geistigen Abbau im Alter ist – jedenfalls mit Gingko – kein Kraut gewachsen.

Ginkgo-Präparate sind ein Klassiker der Naturheilkunde. Bereits seit den 60er Jahren sorgen Extrakte aus den Blättern und Samen des Ginkgobaums für fette Umsätze. Für ein besseres Gedächtnis sollen die Präparate sorgen, die Konzentrationsfähigkeit erhöhen und allgemein der Demenz vorbeugen. Doch eine neue Studie zeigt: gegen den geistigen Abbau im Alter ist – jedenfalls mit Gingko – kein Kraut gewachsen.

Erhöht die Handynutzung das Risiko an einem Hirntumor zu erkranken? Das ist im Kern die Forschungsfrage der sogenannten Interphone-Studie, die im Jahr 2000 gestartet ist. Inzwischen ist die Studie in allen Ländern abgeschlossen. Doch die Publikation der Ergebnisse lässt auf sich warten. Nun scheinen erste Befunde durchgesickert zu sein. Glaubt man der aktuellen Berichterstattung des “Daily Telegraph”, so dürften die Resultate für viel Gesprächsstoff sorgen.

Erhöht die Handynutzung das Risiko an einem Hirntumor zu erkranken? Das ist im Kern die Forschungsfrage der sogenannten Interphone-Studie, die im Jahr 2000 gestartet ist. Inzwischen ist die Studie in allen Ländern abgeschlossen. Doch die Publikation der Ergebnisse lässt auf sich warten. Nun scheinen erste Befunde durchgesickert zu sein. Glaubt man der aktuellen Berichterstattung des “Daily Telegraph”, so dürften die Resultate für viel Gesprächsstoff sorgen.

Wie riskant ist Nanotechnik tatsächlich? Wurde das Risikopotential der winzig kleinen Teilchen in Lebensmitteln, Kleidung und dutzenden weiteren Produkten unterschätzt? Es ist durchaus möglich, daß der heutige Tag eine Trendwende in der Karriere der Nanotechnologie markiert. Denn heute sorgt eine aktuelle Überblicksstudie des Umweltbundesamts für Schlagzeilen. Dessen Experten weisen auf ungeklärte Risiken der Nanotechnologie hin und empfehlen schließlich sogar Nanoprodukte zu vermeiden.

Wie riskant ist Nanotechnik tatsächlich? Wurde das Risikopotential der winzig kleinen Teilchen in Lebensmitteln, Kleidung und dutzenden weiteren Produkten unterschätzt? Es ist durchaus möglich, daß der heutige Tag eine Trendwende in der Karriere der Nanotechnologie markiert. Denn heute sorgt eine aktuelle Überblicksstudie des Umweltbundesamts für Schlagzeilen. Dessen Experten weisen auf ungeklärte Risiken der Nanotechnologie hin und empfehlen schließlich sogar Nanoprodukte zu vermeiden.

Stress wird ja zunächst fast immer als unangenehm empfunden. Wie sollen wir nur die viel zu vielen Termine unter einen Hut kriegen? Wie sind die viel zu hohen Anforderungen zu meistern, die an uns gestellt werden? Wer wirklich gestresst ist, kann diesem Gefühl vermutlich wenig positives abgewinnen. Da paßt es ins Bild, wenn portugiesische Wissenschaftler

Stress wird ja zunächst fast immer als unangenehm empfunden. Wie sollen wir nur die viel zu vielen Termine unter einen Hut kriegen? Wie sind die viel zu hohen Anforderungen zu meistern, die an uns gestellt werden? Wer wirklich gestresst ist, kann diesem Gefühl vermutlich wenig positives abgewinnen. Da paßt es ins Bild, wenn portugiesische Wissenschaftler  Die Infektionen mit dem Schweinegrippevirus H1N1 nehmen weiter zu. Aktuell sind mehr als 4.000 Grippefälle in Deutschland bestätigt, das ist (noch) überschaubar. In Großbritannien etwa sind die Krankheitszahlen in den letzten Wochen enorm angestiegen – die Urlaubssaison könnte auch bei uns zu einer rasanten Ausbreitung führen. Und möglicherweise droht Gefahr aus einer bislang kaum beachteten Richtung: ausgerechnet das Grippemedikament “Tamiflu” könnte zur Entstehung von resistenten Viren beitragen.

Die Infektionen mit dem Schweinegrippevirus H1N1 nehmen weiter zu. Aktuell sind mehr als 4.000 Grippefälle in Deutschland bestätigt, das ist (noch) überschaubar. In Großbritannien etwa sind die Krankheitszahlen in den letzten Wochen enorm angestiegen – die Urlaubssaison könnte auch bei uns zu einer rasanten Ausbreitung führen. Und möglicherweise droht Gefahr aus einer bislang kaum beachteten Richtung: ausgerechnet das Grippemedikament “Tamiflu” könnte zur Entstehung von resistenten Viren beitragen.

Smog macht dumm. So könnte man die Ergebnisse einer aktuellen US-Studie zu den Auswirkungen von Luftverschmutzung auf die Intelligenzentwicklung von Kindern zusammenfassen. Die Studie legt nahe, daß bestimmte Parameter der Luftqualität bereits während der letzten Schwangerschaftsmonate entscheidend sind. Sind Stadtkinder also dümmer?

Smog macht dumm. So könnte man die Ergebnisse einer aktuellen US-Studie zu den Auswirkungen von Luftverschmutzung auf die Intelligenzentwicklung von Kindern zusammenfassen. Die Studie legt nahe, daß bestimmte Parameter der Luftqualität bereits während der letzten Schwangerschaftsmonate entscheidend sind. Sind Stadtkinder also dümmer?

»Die Sonne schickt uns keine Rechnung.« So lautete das mantrahaft vorgetragene Glaubensbekenntnis des Journalisten Franz Alt. Und man darf vermuten, daß Franz Alt in den letzten Wochen die Berichterstattung über das Projekt “Desertec” wohlwollend beobachtet hat; die lange Zeit kaum diskutierte Solarthermie feiert derzeit eine glänzende Renaissance.

»Die Sonne schickt uns keine Rechnung.« So lautete das mantrahaft vorgetragene Glaubensbekenntnis des Journalisten Franz Alt. Und man darf vermuten, daß Franz Alt in den letzten Wochen die Berichterstattung über das Projekt “Desertec” wohlwollend beobachtet hat; die lange Zeit kaum diskutierte Solarthermie feiert derzeit eine glänzende Renaissance.

Epo wirkt! Das belegt nicht nur der Radsport, wo Epo seit den 90er Jahren zur unerlaubten Ausdauersteigerung eingesetzt wurde. Inzwischen sind die fragwürdigen Radhelden vermutlich auf andere Dopingmittel umgestiegen. Doch während die Popularität von Lance Armstrong* und seinen scheinheiligen Kollegen glücklicherweise schwindet, steht Epo möglicherweise erst am Beginn einer vielversprechenden Karriere.

Epo wirkt! Das belegt nicht nur der Radsport, wo Epo seit den 90er Jahren zur unerlaubten Ausdauersteigerung eingesetzt wurde. Inzwischen sind die fragwürdigen Radhelden vermutlich auf andere Dopingmittel umgestiegen. Doch während die Popularität von Lance Armstrong* und seinen scheinheiligen Kollegen glücklicherweise schwindet, steht Epo möglicherweise erst am Beginn einer vielversprechenden Karriere.

Gefäßkeramik und figürliche Keramik

Gefäßkeramik und figürliche Keramik Mit dem Malerpinsel gegen die Klimaerwärmung!? So ähnlich lautet jedenfalls ein Konzept, das US-Energieminister Steven Chu am Mittwoch in London vorstellte. Und Steven Chu, 1997 mit dem Physik-Nobelpreis dekoriert, meint es ernst: Hausdächer, Straßen und Plätze sollen mit weißer Farbe bemalt werden, um die Folgen des Klimawandels einzudämmen.

Mit dem Malerpinsel gegen die Klimaerwärmung!? So ähnlich lautet jedenfalls ein Konzept, das US-Energieminister Steven Chu am Mittwoch in London vorstellte. Und Steven Chu, 1997 mit dem Physik-Nobelpreis dekoriert, meint es ernst: Hausdächer, Straßen und Plätze sollen mit weißer Farbe bemalt werden, um die Folgen des Klimawandels einzudämmen.

Jedes Fußballspiel ist längst zu einem Fest für Statistik-Freaks geworden: wieviele Ecken, Einwürfe oder Freistöße eine einzelne Mannschaft auf ihrem Konto hat, gehört zum Informations-Standard. Die Zahl der gewonnenen Zweikämpfe, die Länge des Ballbesitzes oder die Laufwege einzelner Spieler rundet das übliche Statistik-Angebot ab. Nun klären uns Dortmunder Forscher darüber auf, welche Torhüter als die wahren “Elfmeter-Killer” gelten können.

Jedes Fußballspiel ist längst zu einem Fest für Statistik-Freaks geworden: wieviele Ecken, Einwürfe oder Freistöße eine einzelne Mannschaft auf ihrem Konto hat, gehört zum Informations-Standard. Die Zahl der gewonnenen Zweikämpfe, die Länge des Ballbesitzes oder die Laufwege einzelner Spieler rundet das übliche Statistik-Angebot ab. Nun klären uns Dortmunder Forscher darüber auf, welche Torhüter als die wahren “Elfmeter-Killer” gelten können.

Es sind fast immer die Klassiker: Notizblöcke mit Firmenlogo oder die unvermeidlichen Kugelschreiber mit Werbeaufdruck. Und die große Frage, die sich stellt: Wer zum Teufel braucht diesen Kram? Und wieso überschütten Firmen überhaupt ihre Kunden und Geschäftspartner mit all diesen Werbegeschenken?

Es sind fast immer die Klassiker: Notizblöcke mit Firmenlogo oder die unvermeidlichen Kugelschreiber mit Werbeaufdruck. Und die große Frage, die sich stellt: Wer zum Teufel braucht diesen Kram? Und wieso überschütten Firmen überhaupt ihre Kunden und Geschäftspartner mit all diesen Werbegeschenken?

Wahrscheinlich ist Linus Pauling an allem Schuld. Die Erfolgsgeschichte der Vitamine begann jedenfalls Mitte der 60er Jahre, als Nobelpreisträger Pauling auf die Theorie seines Kollegen Irwin Stone aufmerksam wurde, der eine hochdosierte Vitamin-C-Kur gegen Erkältungen empfahl.

Wahrscheinlich ist Linus Pauling an allem Schuld. Die Erfolgsgeschichte der Vitamine begann jedenfalls Mitte der 60er Jahre, als Nobelpreisträger Pauling auf die Theorie seines Kollegen Irwin Stone aufmerksam wurde, der eine hochdosierte Vitamin-C-Kur gegen Erkältungen empfahl.

Die medizinische Forschung steht bisweilen vor einem Dilemma: einerseits sind viele Studien ohne Zusammenarbeit mit Pharmafirmen überhaupt nicht durchführbar, andererseits stellt sich natürlich die Frage, ob unter diesen Rahmenbedingungen die Regeln guter wissenschaftlicher Praxis einzuhalten sind. Und Interessenskonflikte sind – wie eine aktuelle Analyse belegt – häufiger und subtiler, als man denkt.

Die medizinische Forschung steht bisweilen vor einem Dilemma: einerseits sind viele Studien ohne Zusammenarbeit mit Pharmafirmen überhaupt nicht durchführbar, andererseits stellt sich natürlich die Frage, ob unter diesen Rahmenbedingungen die Regeln guter wissenschaftlicher Praxis einzuhalten sind. Und Interessenskonflikte sind – wie eine aktuelle Analyse belegt – häufiger und subtiler, als man denkt.

Letztlich sind die Unterschiede zwischen der Wissenschaft und dem Formel-1-Zirkus nur marginal. In beiden Fällen ist ein ganzes Team daran beteiligt, um möglichst schnell, möglichst effizient das Ziel zu erreichen. Und am Ende zählt der Platz auf dem Siegerpodest.

Letztlich sind die Unterschiede zwischen der Wissenschaft und dem Formel-1-Zirkus nur marginal. In beiden Fällen ist ein ganzes Team daran beteiligt, um möglichst schnell, möglichst effizient das Ziel zu erreichen. Und am Ende zählt der Platz auf dem Siegerpodest.

Eines meiner liebsten Geräusche ist ja das Prasseln von Regentropfen, die gegen Dach oder Fenster trommeln. Und wenn es einen richtig tollen Regenschauer gibt, dann schaue ich auch gerne aus dem Fenster und sehe gebannt zu, wie die Regentropfen auf dem Boden zerplatzen oder in Pfützen malerische Blasen erzeugen. Auf die Idee, diesen Vorgang genauer zu untersuchen, bin ich allerdings nicht gekommen.

Eines meiner liebsten Geräusche ist ja das Prasseln von Regentropfen, die gegen Dach oder Fenster trommeln. Und wenn es einen richtig tollen Regenschauer gibt, dann schaue ich auch gerne aus dem Fenster und sehe gebannt zu, wie die Regentropfen auf dem Boden zerplatzen oder in Pfützen malerische Blasen erzeugen. Auf die Idee, diesen Vorgang genauer zu untersuchen, bin ich allerdings nicht gekommen.

Haben Sie nicht vor einer Sekunde gehustet? Und sind Sie nicht auch ein bißchen verschnupft? Spüren Sie vielleicht sogar allgemeine Grippesymptome in sich aufsteigen? – Keine Sorge: es dürfte sich kaum um anderes, als eine belanglose Frühjahrserkältung handeln. Die Schweinegrippe, so darf man annehmen, ist es nicht.

Haben Sie nicht vor einer Sekunde gehustet? Und sind Sie nicht auch ein bißchen verschnupft? Spüren Sie vielleicht sogar allgemeine Grippesymptome in sich aufsteigen? – Keine Sorge: es dürfte sich kaum um anderes, als eine belanglose Frühjahrserkältung handeln. Die Schweinegrippe, so darf man annehmen, ist es nicht.

Wenn man krank ist, vielleicht sogar ein Klinikaufenthalt notwendig wird, so bleibt einem nichts anderes übrig, als in die Fähigkeit der behandelnden Ärzte und die Kompetenz des Pflegepersonals zu vertrauen. Doch Ärzte, Schwestern und Pfleger machen Fehler. Und das leider mit System…

Wenn man krank ist, vielleicht sogar ein Klinikaufenthalt notwendig wird, so bleibt einem nichts anderes übrig, als in die Fähigkeit der behandelnden Ärzte und die Kompetenz des Pflegepersonals zu vertrauen. Doch Ärzte, Schwestern und Pfleger machen Fehler. Und das leider mit System…

Alle haben jahrelang hart trainiert. Alle haben sich wochenlang akribisch auf das sportliche Großereignis vorbereitet. Doch am Ende wird nur ein Athlet auf die oberste Stufe des Siegerpodests steigen dürfen. Worin liegt das Geheimnis der Sieger? Was unterscheidet den Gewinner vom Zweitplazierten? Und welche Rolle spielt dabei das Gehirn?

Alle haben jahrelang hart trainiert. Alle haben sich wochenlang akribisch auf das sportliche Großereignis vorbereitet. Doch am Ende wird nur ein Athlet auf die oberste Stufe des Siegerpodests steigen dürfen. Worin liegt das Geheimnis der Sieger? Was unterscheidet den Gewinner vom Zweitplazierten? Und welche Rolle spielt dabei das Gehirn?

Sind Tiere die besseren Meteorologen? Seit Menschengedenken wird jedenfalls versucht, das Wetter durch genau Beobachtung der Tierwelt vorherzusagen. Der auf seiner kleinen Leiter sitzende Wetterfrosch ist sprichwörtlich geworden, aber auch anderen Tieren wird ein feines Gespür für kommende Wetterverhältnisse attestiert. Schwalben beispielsweise. Das Problem: einer empirischen Überprüfung hält die Bauernregel nicht stand. Im Gegenteil: die Flughöhe der Schwalben ist ganz anders, als es das Sprichwort vermuten läßt.

Sind Tiere die besseren Meteorologen? Seit Menschengedenken wird jedenfalls versucht, das Wetter durch genau Beobachtung der Tierwelt vorherzusagen. Der auf seiner kleinen Leiter sitzende Wetterfrosch ist sprichwörtlich geworden, aber auch anderen Tieren wird ein feines Gespür für kommende Wetterverhältnisse attestiert. Schwalben beispielsweise. Das Problem: einer empirischen Überprüfung hält die Bauernregel nicht stand. Im Gegenteil: die Flughöhe der Schwalben ist ganz anders, als es das Sprichwort vermuten läßt.

Scharlatan oder Pionier der Schmerztherapie?

Scharlatan oder Pionier der Schmerztherapie?

Nach welchen Kriterien wählen Sie Ihren Wohnort aus? Ist es die gute Anbindung an das öffentliche Nahverkehrsnetz oder der naheliegende Stadtpark, die den Ausschlag gegeben haben? Oder waren es am Ende die zahlreichen Fast-Food-Restaurants, die nur wenige Meter entfernt mit Currywurst, Pommes, Burger und Döner die hungrige Laufkundschaft bedienen?

Nach welchen Kriterien wählen Sie Ihren Wohnort aus? Ist es die gute Anbindung an das öffentliche Nahverkehrsnetz oder der naheliegende Stadtpark, die den Ausschlag gegeben haben? Oder waren es am Ende die zahlreichen Fast-Food-Restaurants, die nur wenige Meter entfernt mit Currywurst, Pommes, Burger und Döner die hungrige Laufkundschaft bedienen?