Nicht wenige Raumfahrt-Enthusiasten sind gerade ziemlich erbost, wie mit den Rosetta-Bildern umgegangen wird. Da wurden erst Bilder von der französischen Raumfahrtagentur CNES vermutlich versehentlich zu früh online gestellt und verschwanden dann wieder, weil irgendjemand anders hinter den Kulissen die wieder zurück gepfiffen hat. Ein offener Brief wurde also geschrieben, um nach Echtzeit-Bildern von Rosetta zu verlangen. Florian hat sich dazu bereits geäußert.

Ich kann Raumfahrer.net schon verstehen. Und ein offener Brief an die ESA und den PI der Osiris-Kamera ist schon mal ein guter Anfang. Aber damit ist es nicht getan. Ich nehme mal aber die Geschichte um die Rosetta-PR, um mal einiges über die europäische Forschungslandschaft aus meiner Sicht zu erläutern, weil ich beide Sichtweisen kenne.

Ich habe mich einerseits immer für mehr Öffentlichkeitsarbeit und Transparenz eingesetzt, andererseits kenne ich auch die Sachzwänge im Hintergrund, die einem manchmal diese Arbeit sehr, sehr schwer und teilweise sogar unmöglich machen. Der Tag hat nur 24 Stunden, ich muss auch von was leben und reklamiere inzwischen auch mein Recht auf Freizeit.

Zudem habe ich jahrelang für die Radio Science Gruppe auf Rosetta gearbeitet und dabei u.a. auch die Daten aufbereitet für die Freigabe an die Öffentlichkeit. Und saß dabei regelmäßig mit den Leuten der ESA zusammen, die sich nach bestem Wissen und Gewissen bemühten, dabei zu helfen, dass die Daten irgendwann – wie versprochen – rausgehen. Ich weiß auch – zumindest von den Radiowellen-Daten -, was alles notwendig ist, damit irgendjemand anders irgendetwas damit anfangen kann. Das ist bei Radiodaten natürlich um einiges aufwendiger als bei Bildern, aber auch die haben ihre Tücken, von denen die meisten in der Anfangsphase des Betriebs im Weltall noch nicht einmal bekannt sind. Deswegen gibt es die so genannte Commissioning-Phase, in der die Leute erstmal Erfahrungen mit ihren Instrumenten sammeln müssen. Wir hatten bei Rosetta bereits einige Commissioning-Phasen kurz nach dem Start. Jetzt im Anflug von Churyumov-Gerasimenko wird es da sicherlich noch mal solche Phasen geben, weil die Raumsonde sich einer relativ “verschmutzen Umgebung” nähert; voll mit Plasma und Gas, das vom Kometen selbst ausgestoßen wird und wo noch nicht klar ist, wie das die einzelnen Instrumente beeinflusst.

Glaubwürdigkeit über alles

Glaubwürdigkeit erachten gerade WissenschaftlerInnen älteren Kalibers als ein rares Gut, das man nicht leichtfertig verspielen sollte. Denn das brauchen die Leute, um Drittmittel von den Forschungsgemeinschaften für die Zeitverträge ihrer MitarbeiterInnen zusammenzukriegen. Ohne dieses Geld, bricht wirklich alles zusammen.

Von daher finden es nicht wenige Verantwortliche in der europäischen Wissenschaft ganz super, dass sie eben nicht halbgaren Quark raushauen, den man ein halbes Jahr später korrigieren oder gar widerrufen muss (Arsen-Bakterien der NASA? Da war was, nicht?). Lieber wartet mensch etwas länger, um sich ja keine Blöße zu geben. Wenn also Raumfahrt-Enthusiasten den Rosetta-Verantwortlichen Öffentlichkeitsarbeit aus dem letzten Jahrtausend vorwerfen, dann werden das einige KollegInnen vielleicht eher als Kompliment denn als Vorwurf sehen. Schaut doch mal, wann die Leute wissenschaftlich groß geworden sind! In den 80er Jahren des letzten Jahrtausend.

Die argumentieren nach dem Motto: Gut, dass wir uns diesem Social Media Dings entziehen. (Hat Rosetta überhaupt eine Facebook-Seite? Ich konnte keine finden. Florian hat mich darauf hingewiesen, doch ja, es gibt ne Facebook-Seite.) Die Berührungsängste sind groß und einige bezeichnen sich auch als gebrannte Kinder:”Da hab ich das ewig und lang erklärt und es kam immer noch halbgarer Kram bei dem Medium heraus, der dann auf mich zurückfällt.”Mir wurde selbst sehr nahegelegt tunlichst nicht von einer europäische Konferenz zu twittern, und ich werde mich auch hüten, solange ich noch im europäischen Forschungsumfeld arbeiten möchte. Ich sehe schon, dass amerikanische Kolleginnen damit weniger Probleme haben, aber Europa ist nicht die USA.

Behindert es die Öffentlichkeitsarbeit? Manchmal schon. Statt peinlicher Falsch-Meldungen passieren dann folgende Dinge.

Beispiel 1: Ich hab schon mitangesehen, wie KollegInnen sich quer über Europa über die zweite Nachkomma-Stelle eines Wertes stritten, um dann die Pressemitteilung nach Redaktionsschluss der europäischen Print-Medien rauszuhauen, um hinterher beleidigt zu sein, dass diese die Meldung gar nicht mehr gedruckt wurde.

Beispiel 2: Ich musste schon mal eine piss-langweilige Pressemitteilung raushauen, die nur eingefleischte Liebhaber der Materie unter den JournalistInnen aufgriffen, weil mein Auftraggeber darauf bestand, dass man erst einmal alle Institute und Beteiligten in voller Länge erwähnen musste, bevor endlich mal geschrieben werden konnte, worum es ging und warum das so toll ist. Umgekehrte Pyramiden-Struktur…pfff Es war viel wichtiger, die wichtigen Leute zu erwähnen.

Zu Ruhm und Ehre des Chefs/der Chefin

PR dient den einzelnen Arbeitsgruppen zuallererst einmal der Selbstbeweihräucherung. Öffentlichkeitsarbeit umfasst natürlich dann auch den Bildungsauftrag, aber gerade jetzt bei Rosetta hoffen sicherlich nicht wenige, dass Medienpräsenz ihnen beim Eintreiben von Forschungsgeldern hilft (ohne die alles zusammenbricht). Nach meiner Meinung ist letzteres – zumindest in Deutschland – ein Irrtum. Medienpräsenz interessiert die, welche letztendlich den ihn zugewiesenen Teil Eurer Steuergelder an die ForscherInnen verteilen, meiner Erfahrung nach herzlich wenig. Publikationen gehen über alles. Ach ja zum Bildungsanspruch: Nicht selten stehen Hochschul-Lehrer den Experimenten vor, die zwischendurch auch im Hörsaal sind. Sie haben also bereits einen dezidierten Bildungsauftrag, der zuallererst erfüllt werden muss.

Aufklärung der Öffentlichkeit wird außerdem nicht selten eher als Aufgabe der JournalistInnen gesehen und wenn die angeblich oder tatsächlich versagen, dann wird das dann leider auch als Bestätigung gesehen, sich noch weiter einzuigeln. Engagierte PressesprecherInnen und DiplomandInnen, DoktorandInnen und Postdocs haben so langsam verstanden, dass es allen Seiten hilft, auch mal was zu erklären. Aber es ist nicht unbedingt etwas, was bei den gestandenen WissenschaftlerInnen angekommen ist.

Es ist ja auch nicht so, dass das System die belohnt, die sich in Öffentlichkeitsarbeit engagieren. Es ist sogar eher das Gegenteil. In der Zeit könnte mensch ja Publikationen schreiben. Hab ich so bereits mehrfach über andere hinter vorgehaltener Hand gehört. Sogar von Leuten, die sich eigentlich rühmen für Öffentlichkeitsarbeit zu sein und Vorträge am DLR und Sternwarten geben.

Viele können es einfach nicht, weil sie es nie gelernt haben

Und selbst die, welche sich irgendwie die Zeit nehmen ab und an Öffentlichkeitsarbeit zu betreiben, sind teilweise nicht gut darin. Die andere Seite der Wahrheit ist allerdings auch, dass ich an der Uni Köln, die wahrlich nicht klein ist, in meiner gesamten Zeit dort nur einmal einen Medien-Kurs mitgemacht habe und ich wurde aufgrund der geringen Anzahl an Plätzen persönlich angesprochen, ob ich einen mitmachen wollte. Das Angebot kam von dem neuen Pressesprecher, der ganz erstaunt war, dass es sowas noch nicht gab. Woher sollen WissenschaftlerInnen es also lernen? Vor allem, bei all den anderen Dingen, die sie angeblich eigentlich tun sollten: Publizieren! Habe ich schon erwähnt, dass die, die an den Geldhähnen sitzen, v.a. auf die Publikationsliste gucken? Um dann zu entscheiden, welche Arbeitsgruppe weiterleben darf?

Es ist kaum Geld für PR da

Ich hab mal im Juni 2004 eine Veranstaltung im Rahmen des Venustransits organisiert, speziell für Schülerinnen. Ich musste förmlich bei allen mit bekannten Pressestellen betteln gehen, um genug Material für 300 SchülerInnen zum Verteilen zusammen zu bekommen. Und wir sprechen hier von Plastik-Tüten mit ESA-Aufschrift und Info-Broschüren mit einem gewissen Inhalt. Das lag auch nicht an den PR-KollegInnen, die sich ein Bein ausgerissen haben, um mir zu helfen. Es war einfach nicht mehr da, und es musste ja auch genug für andere übrig bleiben. Das hat mich damals als Frischling ziemlich erschüttert. Ich sehe auch nicht, dass es besser geworden ist.

Personalmittel sind auch nur begrenzt da. Die ESA kann es alleine von der Man-Power kaum mit der NASA aufnehmen. Ich selbst habe jahrelang als Doktorandin PR nebenher betrieben. Das ist übrigens die häufigste und kostengünstigste Variante. Der Chef/die Chefin drückt es einem jungen Menschen auf’s Auge, der Bock drauf hat.

Akute Geldnot

Wenn wir mal ganz, ganz ehrlich sind, dann haben wir schon zu wenig Geld, um Wissenschaft zu betreiben. Das Problem hatten deutsche WissenschaftlerInnen bei Huygens und Venus Express, dass auf einmal kein Geld mehr da war, um mit den Daten auch zu arbeiten. Es ist italienischen KollegInnen auf Mars Express passiert. Ach was rede ich, wir bekamen nach dem Start von Venus Express vom Chef mitgeteilt, dass leider die versprochenen Gelder nicht fließen würden, um die Radiowellen-Daten auszuwerten. Da hatten wir noch das Glück, dass wir bei Mars Express ein ähnliches Instrument an Bord hatten, die Infrastruktur stand und sich bereits bei MEX bewährt hatte, so dass zumindest die grundlegende operationelle Arbeit halbwegs nebenher erledigt wurde. Die zusätzliche Last wurde, solange bis wieder irgendwo Gelder aufgetrieben werden konnten, auf uns alle verteilt. Und es war ja nicht so, dass wir zu dem Zeitpunkt nicht alle bereits hackedicht mit Arbeit waren.

Meistens leiden so getroffene WissenschaftlerInnen still vor sich hin und versuchen irgendwo mal Geld locker zu machen, um irgend etwas auf die Reihe zu kriegen. Und solange arbeiten sie nebenher irgendwie dennoch mit den Daten, obwohl sie eigentlich noch tausend andere Dinge zu tun haben. Weil ja publiziert werden muss.

Man könnte natürlich einwenden, dass WissenschaftlerInnen das Publizieren verweigern könnten, solange kein Geld da ist. Nur tut das keiner, weil die nicht unbegründete Angst herrscht, dass man hinterher noch weniger Geld kriegt, weil man ja nicht genügend publiziert hat. Und ich hab schon live und in Farbe gesehen, wie Arbeitsgruppen fast gekillt worden sind, obwohl die super Ergebnisse raushauen und das ist ein weltweites Phänomen. Da blieben versprochene Gelder an einer entscheidenden Stelle einfach aus oder es wurden mal eben feste Stellen gestrichen oder irgendwer meinte sich mit irgendjemandem anlegen zu müssen und schon brach das ganze Kartenhaus zusammen. Das ist nicht lustig, v.a. wenn mensch denkt: Das könnte Dir auch passieren.

Im Falle von Huygens gab es zumindest mal einen öffentlichen Aufruf der europäischen Wissenschaftler, der es auch in die Presse schaffte. (Ich finde den Text aber leider nicht mehr. Ich glaube, es stand bei Spiegel-Online). Sonst kriegt man von dem mehr oder weniger stillem Leiden hinter den Kulissen nichts mit.

Und dann dieses gottverdammte Hochschulrahmen-Gesetz, das meiner Meinung nach der deutschen Wissenschaft das Genick gebrochen hat. Forschung wird im Moment v.a. von DoktorandInnen erledigt, ProfessorInnen sind derart gestresst vom Fördermittel eintreiben und dem sonstigen Verwaltungskram und Netzwerkpflege – sprich Konferenzen, ach ja und Lehre muss auch noch betrieben werden – dass eigentlich gar keine Zeit mehr bleibt, um den DoktorandInnen unter die Arme zu greifen. Letztere arbeiten immer noch zu oft für einen Hungerlohn und nach ein paar Jahren ist Schluss und dann kommt der/die nächste, die wieder eingearbeitet werden muss usw. usf.. Kurz: Es ist ein Kartenhaus, erwähnte ich schon.

Publikationen sind überlebenswichtig

Viele Forschungsgruppen stehen mit dem Rücken zur Wand. Und das letzte, was irgendeiner riskieren möchte ist, dass jemand anders als sie mit den Daten publiziert, für die sie Jahre ihres Lebens investiert haben. Und ja, da sind die KollegInnen paranoid. Ihr habt keine Ahnung wie paranoid. Weil es hier schlicht um die Existenz geht. Und es kommt ja auch vor. In nem Klima, wo es nur darum geht viel zu publizieren, werden dann schon mal Daten von Konferenzen ‘geklaut’. Ach ja und was steht im Artikel ‘Many high-profile journals, including Nature, have strict rules about authors publicizing data before publication.’

Wisst Ihr, was das heißt?

Wenn Ihr in Nature publizieren wollt, dann dürft Ihr die Daten nicht vorher rausgeben. Und high-profile journals sind wiederum genau das, was WissenschaftlerInnen brauchen, damit sie aus dieser Lotterie, zu der wissenschaftliche Arbeit langsam aber sicher verkommt, nicht rausfliegen. Es muss nicht nur viel publiziert werden, sondern auch noch in Edelpapern. Die, die damit ein Problem haben, verlassen das System. Die, die drin bleiben, haben sich damit arrangiert. Und jetzt ratet mal, ob das die sind, die gerne und gut PR betreiben?

Und was soll auch die ESA sagen, wenn ein PI (also der wissenschaftliche Chef) sagt, dass kein Geld da ist, um Wissenschaft, geschweige denn Datenarchivierung und PR zu machen? Die verwalten auch den Mangel und sind an Verträge gebunden und die sehen nun mal vor, dass die Daten erst einmal den WissenschaftlerInnen gehören. Für normalerweise 6 Monate.

Ach ja und es wird immer wieder die NASA als großes Vorbild in der Diskussion genannt. Sogar NASAs Kepler hat eine Verlängerung der Eigentumsphase durchgesetzt, weil sie Angst hatten, dass jemand anders ihnen mit der Publikation zuvorkommen könnte. Und brachen damit dann sogar ihre eigenen Regeln. Weil Publikationen dass allerallerwichtigste ist, weil die Leute sonst keine Förderanträge kriegen, um Ihre auf Zeitverträgen sitzenden MitarbeiterInnen bezahlen zu können.

Warum machen wir eigentlich noch weiter?

Aus demselben Grund, warum wir dann doch ab und an Zeit für PR finden. Weil es ‘leider geil’ ist. Es ist ja spannend und unser Herzblut hängt dran. Weil Forschung, wenn es denn halbwegs funktioniert auch unheimlich befriedigend ist. Es ist ja auch nicht so, dass in der freien Wirtschaft alles supi ist. Zumindest für eine Weile hält das Gefühl, was wirklich einzigartiges zu machen, auch vor. Für mich persönlich, habe ich mich damit abgefunden, dass meine Rente vermutlich minimal sein wird und ich mit viel Glück vielleicht eine kleine Wohnung mein eigen nennen werde, wenn ich auf größere Urlaube verzichte. Dafür habe ich eben ‘geile Sachen’ gemacht, auf die ich stolz bin und die mir Spaß machen. Noch. Aber ich mache nicht (mehr) alles mit und dann suche ich mir eben, vielleicht irgendwann einen Job in der freien Wirtschaft. In den USA nehmen sie zumindest noch Leute, die spät von der Uni abgehen.

Was tun?

Nicht auf die Falschen einprügeln

Die ESA ist meiner Erfahrung nach noch die Organisation, die am ehesten auf Eurer Seite steht. Und mit Euch meine ich die, die an Forschung interessiert sind. Mit der ESA würde ich es mir nicht verscherzen, aber auch keine Wunderdinge erwarten. Sie sind an existierende Verträge gebunden, die sie im Alleingang nicht aushebeln können. Bei den ForscherInnen müsst Ihr verdammt aufpassen, dass die sich nicht noch mehr in die Enge getrieben fühlen, sonst gehen reflexartig die Scheuklappen hoch. Ich finde den offenen Brief an sich richtig, aber im Ton doch so, dass es mich nicht wundern würde, wenn KollegInnen sagen: Wir reißen uns bereits beide Beine aus, was wollt Ihr denn noch von uns?

Where is the money?

Ja, Ihr seid die SteuerzahlerInnen und im Grunde wissen die WissenschaftlerInnen, dass es ohne Euch gar nicht geht. Aber es ist nun mal eine riesige Kluft dazwischen. Ihr drückt den ForscherInnen das Geld nicht direkt in die Hand. Das machen Eure VertreterInnen und deren Priorität liegt nicht auf Öffentlichkeitsarbeit. Dazu kommt noch, dass Raumfahrt Grundlagen-Forschung ist, die schon von vornherein benachteiligt ist gegenüber Forschung, die einen unmittelbar verständlichen materiellen Nutzen bringt. Wir haben hier das “Wozu-soll-es-gut-sein”-Problem. Auf jeden Raumfahrtenthusiasten kommen zehn andere, für die es eine sinnlose Geldverschwendung ist. Die sind auch SteuerzahlerInnen. Andererseits wissen die wenigsten Forschungsfans wie Forschung wirklich aussieht und wieviel Kampf und Frust dahinter steckt. Meine eigene Schwester konfrontiert mich regelmäßig mit völlig falschen Ideen, wie sie denkt, wie mein Alltag abläuft. Weil wir auch lange Zeit nichts gesagt haben. Vermutlich, um den Nachwuchs nicht zu verschrecken oder in der irrigen Hoffnung, dass es doch vielleicht wieder besser wird.

Also, wenn Ihr wirklich wollt, dass mehr PR geschieht, dann hat die europäische Forschungslandschaft als Ganzes mehr Geld nötig und vor allem muss langsam Schluss sein mit den elenden Zeitverträgen, die keinerlei Planungssicherheit bieten. Und es muss gezeigt werden, dass sich Öffentlichkeitsarbeit (und gute Lehre) sich wirklich lohnt.

Ihr könntet mit Euren VolksvertreterInnen im Bundestag/Landtag/in der Kommunalverwaltung reden, an das Bundesministerium für Bildung und Forschung appelieren, schreibt an das Europäische Parlament, dass Ihr vernünftige PR wollt und dass es sich auch für die ForscherInnen lohnen muss.

Alternative Forschungsfinanzierung

Ich sehe auch eine gewisse Zukunft in Crouwdfunding. Damit könntet Ihr wirklich den ForscherInnen das Geld direkt gegen Gegenleistung in die Hand drücken, wie bei den ScienceStartern. Die Planetary Society macht Lobbyarbeit für Planetenforschung.

P.S.: Dass die ganze derzeitige Forschungs-Situation auf lange Sicht weder gut für die Wissenschaft noch für die universitäre Lehre ist, sollte sich von selbst verstehen. Aber es ist harter, harter Weg, sich daraus wieder zu befreien. Ich hab für mich entschieden, dass ich zwar finanziell nichts groß erwarte von meinem Traumjob, aber meine persönliche Integrität lass ich mir nicht nehmen. In dem Moment wird es dann nämlich zum Alptraum-Job und das muss und will ich nicht.

]]>

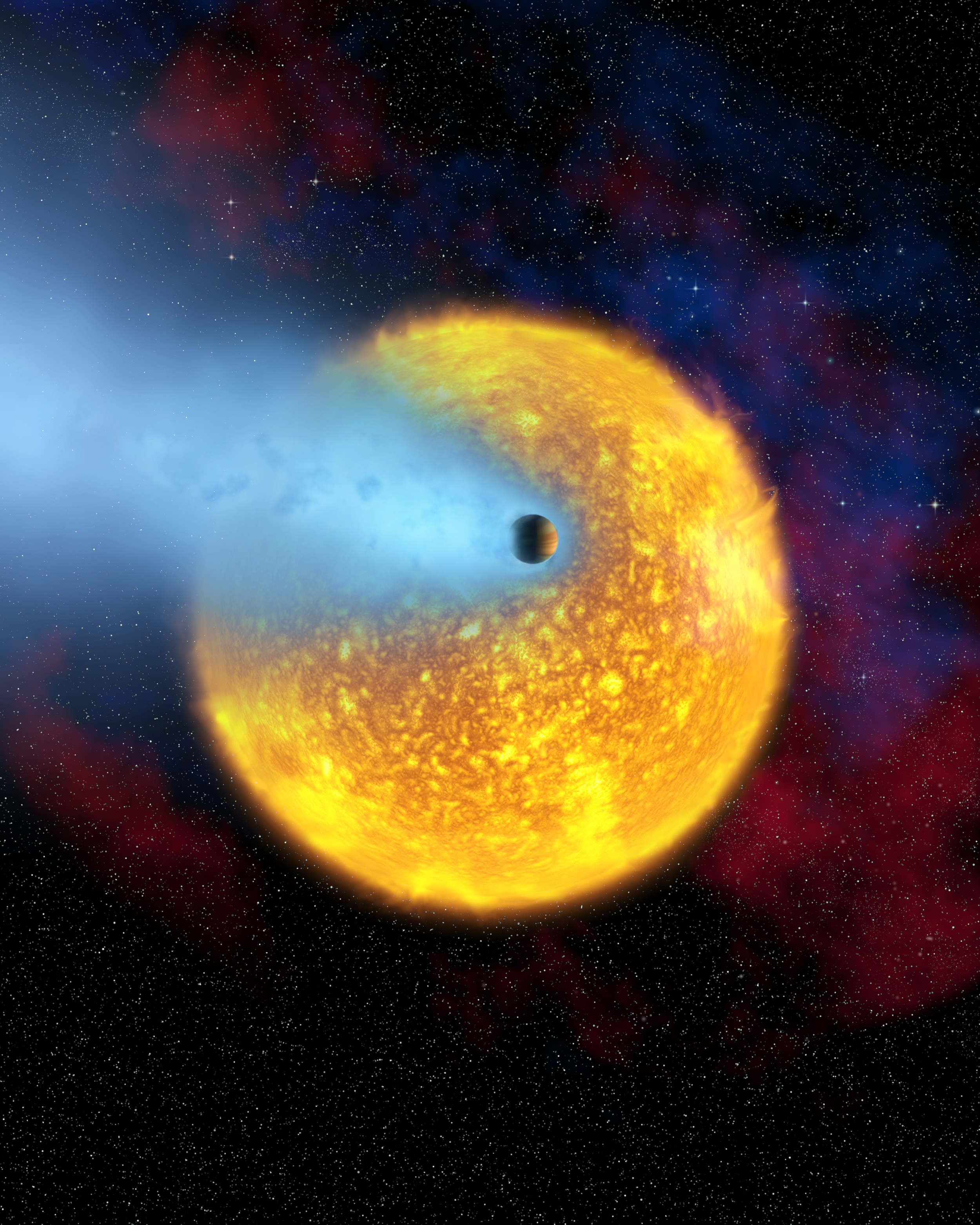

Ich hatte im ersten Teil erzählt, dass Exoplaneten um kleine kühle M- und K-Sterne selbst dann habitabel sein können, wenn sie durch Gezeiten in eine Situation gebracht wurden, die ihnen eine ewige Tag- und Nachtseite beschert. Das alles steht und fällt allerdings mit der Zirkulation.

Ich hatte im ersten Teil erzählt, dass Exoplaneten um kleine kühle M- und K-Sterne selbst dann habitabel sein können, wenn sie durch Gezeiten in eine Situation gebracht wurden, die ihnen eine ewige Tag- und Nachtseite beschert. Das alles steht und fällt allerdings mit der Zirkulation.

![2014-06-12_17.23.34[1]](https://scienceblogs.de/planeten/files/2014/07/2014-06-12_17.23.341-300x225.jpg)

![2014-06-12_17.21.49[1]](https://scienceblogs.de/planeten/files/2014/07/2014-06-12_17.21.491-e1406844766688-225x300.jpg)

![2014-04-13_15.42.33[1]](https://scienceblogs.de/planeten/files/2014/07/2014-04-13_15.42.331-300x225.jpg)

![2014-04-13_15.31.46[1]](https://scienceblogs.de/planeten/files/2014/07/2014-04-13_15.31.461-300x225.jpg)